Un legislatore con un dottorato in IA sui pericoli della tecnologia

Non si tratta di robot killer, afferma Jay Obernolte

PAYPAL: Clicca qui

STRIPE: Clicca qui

In alternativa, è possibile effettuare un bonifico bancario (SEPA) utilizzando il nostro conto

Titolare del conto: Come Don Chisciotte

IBAN: BE41 9674 3446 7410

BIC: TRWIBEB1XXX

Causale: Raccolta fondi

Possiamo stare tranquilli? Secondo il deputato americano intervistato da Joseph Lord, la tecnologia in sé non dovrebbe rappresentare un problema ma, come per le armi (che non sparano da sole), tutto dipende dalle mani in cui andrà a finire. In questo senso, non ci dice quasi niente di nuovo, se non sfatare le leggende che “la Mecca del cinema” continua a sfornare a getto continuo. È sicuramente da apprezzare il fatto che, molto raramente, tra i politici si trovi qualcuno che sa di cosa parla e, a parte l’ossessione tipicamente “yankee” per il “pericolo giallo” (vedere la trave nell’occhio del vicino non significa non averne nel proprio), i termini entro cui colloca la questione Intelligenza Artificiale. D’altra parte, comunque, il suo non è un atteggiamento critico unidirezionale; direi anzi che parla abbastanza chiaro anche ai suoi compatrioti.

Joseph Lord – The Epoch Times – 21 aprile 2023

L’unico membro del Congresso ad avere una laurea avanzata in Intelligenza Artificiale invita alla cautela mentre altri legislatori e leader del settore si affrettano a regolamentare la tecnologia.

Il deputato Jay Obernolte (R-Calif.), uno di solo quattro programmatori di computer presenti nel Congresso, nonché l’unico ad avere un dottorato in Intelligenza Artificiale, sostiene che la fretta di regolamentare[questa tecnologia] è sbagliata. Obernolte ha altresì dichiarato che le sue maggiori preoccupazioni riguardo all’intelligenza artificiale riguardano invece l’uso potenzialmente “orwelliano” di tale tecnologia da parte dello Stato.

Di recente, una coalizione di leader tecnologici come Elon Musk, proprietario di Twitter, e Tim Cook, A.D. di Apple, ha chiesto l’abbandono totale della ricerca e dello sviluppo dell’IA. Ciò ha fatto seguito al rilascio di ChatGPT 4, un chatbot di intelligenza artificiale estremamente potente che, tra le altre cose, ha completato test come l’esame di abilitazione per avvocati al 90° percentile e ha superato il [test] SAT.

Il rilascio di ChatGPT 4, l’intelligenza artificiale più potente [attualmente] sul mercato, ha fatto temere che l’intelligenza artificiale stesse diventando molto più intelligente e molto più rapidamente del previsto. Nella loro lettera, i leader del settore tecnologico hanno chiesto di bloccare per sei mesi lo sviluppo di nuove IA e hanno invitato il Congresso a regolamentare la tecnologia.

Obernolte si è incontrato con The Epoch Times per discutere sull’IA, affermando che la regolamentazione è sconsiderata e si basa su un’incomprensione fondamentale della tecnologia dell’IA.

“Non sto dicendo che non dovremmo regolamentare“, ha precisato Obernolte. “Penso invece che alla fine la regolamentazione sarà necessaria“.

Ma ha anche aggiunto che i legislatori devono assicurarsi di “comprendere quali sono i pericoli da cui stiamo cercando di proteggere i consumatori“.

“Se non abbiamo questa comprensione, allora è impossibile creare un quadro normativo che protegga da questi pericoli, che è lo scopo principale della regolamentazione“, ha detto Obernolte. “In questo momento, è molto chiaro che non abbiamo una buona comprensione dei pericoli“.

Altri membri del Congresso hanno chiesto un’azione tempestiva sulla questione.

“È qualcosa che ci coglierà di sorpresa e arriveremo al punto in cui saremo troppo coinvolti per apportare cambiamenti significativi prima che sia troppo tardi“, ha dichiarato a Fox News il deputato Lance Gooden (R-Texas).

Lui e altri esponenti di entrambi i partiti hanno espresso preoccupazione per la possibilità che l’IA prenda il posto di lavori precedentemente svolti dall’uomo. Altri si preoccupano della cosiddetta “Singolarità“, un momento previsto nello sviluppo dell’IA in cui quest’ultima supererà l’intelligenza e le capacità umane.

Non è probabile che l’IA conquisti il mondo

Obernolte ha affermato che la lettera dei leader tecnologici “è utile per richiamare l’attenzione sull’emergere dell’IA e sugli impatti che avrà sulla nostra società“. Ha però anche fatto notare che per i non addetti ai lavori le paure più grandi legate all’IA sono quelle dei film di Terminator, una serie di IA che prendono il controllo delle reti informatiche umane e distruggono il mondo in un’apocalisse nucleare.

“Il profano probabilmente pensa che il pericolo maggiore dell’IA sia un esercito di robot malvagi che si alzano per conquistare il mondo“, ha detto. “Non è questo che tiene svegli di notte i progettisti e gli sviluppatori dell’IA. Di certo non tiene me sveglio la notte“, ha detto Obernolte.

Prima che il Congresso possa prendere in considerazione una regolamentazione, ha proseguito Obernolte, deve “definire il pericolo” nel contesto dell’IA. “Cosa temiamo possa accadere? Dobbiamo rispondere a questa domanda per rispondere alla domanda [su come e quando regolamentare]”.

Un grande timore citato da Obernolte è lo sviluppo di “capacità emergenti” nell’IA. Si tratta di una situazione in cui un’IA è in grado di fare qualcosa per cui non è stata inizialmente programmata. Ma Obernolte ha anche affermato che questo non è un problema così grave come alcuni sostengono, poiché segue tendenze simili osservate nei cervelli dei primati.

“Una delle cose che allarmano i critici dell’IA sono le cosiddette capacità emergenti“, ha spiegato Obernolte. “La capacità di un algoritmo di fare qualcosa che non è stato addestrato a fare, che non si pensava nemmeno che sarebbe stato in grado di fare, e [che] all’improvviso [si scopre che] è in grado di farlo.

“Questo spaventa e allarma le persone“, ha continuato. “Ma se ci pensate, non dovrebbe essere così allarmante, perché si tratta di reti neurali. Il nostro cervello è una rete neurale. Ed è così che funziona il nostro cervello. Se si considerano le dimensioni dei cervelli dei primati, si nota che, con l’aumento delle dimensioni del cervello, all’improvviso cominciano a emergere cose come il linguaggio… e stiamo scoprendo le stesse cose sull’intelligenza artificiale. Quindi non lo trovo allarmante“.

Obernolte ha detto che la reale funzione di ChatGPT 4 non fa che rafforzare la sua posizione.

“Se si osserva da vicino ChatGPT 4, questo rafforza la veridicità di ciò che sto dicendo“, ha detto Obernolte. “L’intelligenza artificiale è tremendamente potente ed efficiente nel riconoscimento di modelli“.

“ChatGPT 4 è stato progettato per recepire una enorme quantità di linguaggio, immagini e prosa al fine di sintetizzare le risposte alle domande“, ha aggiunto. “Se si inquadra ciò che ha allarmato [i critici dell’IA], nel contesto di tutti i dati di cui è stata addestrata a riconoscere gli schemi, diventa molto meno allarmante“.

L’IA non può pensare o ragionare

Un altro aspetto importante dell’IA che Obernolte ha sottolineato è la sua incapacità di superare il test di Turing o di ragionare in modo indipendente.

Questo aspetto è importante perché se l’IA non è in grado di ragionare come un essere umano e di agire in modo indipendente, non rappresenta un rischio per gli esseri umani. Quasi tutti i timori sull’IA riguardano il fatto che l’IA diventi indipendente dall’umanità e che lavori contro gli interessi dell’umanità.

Ma finora, ha osservato Obernolte, la tecnologia non è nemmeno in grado di imitare in modo affidabile un essere umano.

Il test di Turing, proposto dal decifratore britannico della Seconda Guerra Mondiale Alan Turing, descrive la somiglianza di una macchina con un essere umano. Affinché una IA “passi” il test di Turing, gli esseri umani che le parlano via chat non devono essere in grado di capire che stanno parlando con un’IA. Il test è stato proposto come misura del perfezionamento della tecnologia delle IA.

Molti considerano il test di Turing come il test più probante per misurare l’intelligenza artificiale. Ad oggi, nessuna IA è in grado di superare il test di Turing.

Obernolte ha affermato che anche se in futuro un’IA riuscisse a superare il test di Turing, ciò non significherebbe necessariamente che sia “un’entità pensante e ragionante”.

È una questione di dibattito filosofico se le IA possano mai avere motivazioni o compiere azioni indipendenti nello stesso senso degli esseri umani. Almeno per il prossimo futuro, secondo Obernolte, non c’è motivo di preoccuparsi.

“Certamente ChatGPT 4 non può superare il test di Turing“, ha detto Obernolte. “Potrebbe essere che ChatGPT 6 o 7 possano suerarlo di Turing. Può darsi che ci riescano. Potremmo stare seduti per un’ora, discutendo di tutto, e non essere in grado di determinare se si tratta di una persona o di un computer: questo non significa comunque che abbiamo creato un’entità pensante e ragionante“.

La regolamentazione darebbe potere ai nemici degli Stati Uniti

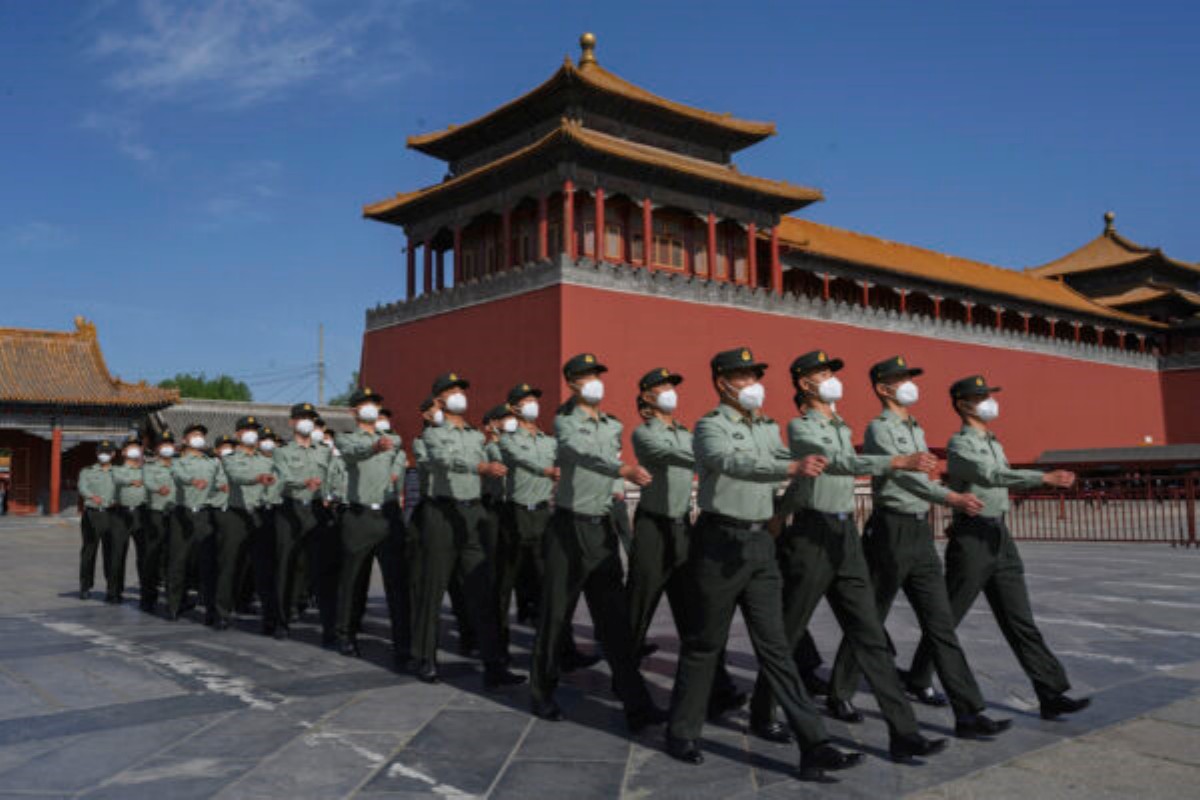

Obernolte ha affermato che la chiusura della ricerca statunitense sulla tecnologia IA servirebbe solo a rafforzare i nemici dell’America.

“Nel caso più draconiano, supponiamo che domani io introduca una legge che imponga a tutti gli Stati Uniti d’America di interrompere lo sviluppo di IA che vadano oltre le capacità del GPT 4“, ha detto Obernolte. “Ma negli Stati Uniti ci sarebbero ancora dei “cattivi soggetti” che, vedendo un guadagno economico nel continuare a sviluppare IA avanzate, continuerebbero a farlo, violando la legge. Ci sarebbero ancora avversari stranieri che la utilizzerebbero“.

Quindi, secondo Obernolte, lo sviluppo dell’IA continuerebbe a verificarsi, ma solo tra gli operatori del mercato nero e gli avversari degli Stati Uniti.

“È innegabile che se interrompessimo lo sviluppo dell’IA avanzata, metteremmo il nostro Paese a maggior rischio di attacco“, ha affermato. “Perché quando riprenderemo, la nostra IA non sarà così avanzata come quella di chi non si è fermato. Quindi non è realistico dire: ‘Smettete tutti di fare quello che state facendo’“.

“Parliamone“, ha aggiunto. “Mi fa piacere che se ne parli“.

Usi “orwelliani

Obernolte ha detto di non temere che l’IA diventi indipendente e distrugga l’umanità, ma bensì di essere preoccupato per gli usi “orwelliani” che la tecnologia potrebbe avere.

“Mi preoccupano altri pericoli molto reali che, a loro modo, sono altrettanto conseguenti e pericolosi della conquista del mondo da parte dei robot, ma in modi diversi“, ha detto Obernolte.

Per esempio, ha citato “la straordinaria capacità dell’intelligenza artificiale di penetrare nella privacy digitale personale“.

Il risultato, ha detto, potrebbe essere quello di aiutare le entità governative o aziendali a prevedere e controllare il comportamento.

Obernolte ha osservato come l’IA potrebbe mettere insieme dati precedentemente disaggregati “e usarli per formare modelli comportamentali che fanno previsioni spaventosamente accurate sul futuro comportamento umano. E, tra l’altro, dare alle persone indizi su come influenzare il futuro comportamento umano“.

“È già stato fatto“, ha aggiunto, indicando le aziende di social media il cui modello di business ruota attorno alla raccolta e alla vendita di dati personali.

A livello aziendale, Obernolte ha detto che questo potrebbe significare che pochi grandi operatori potrebbero avere un “monopolio” sui dati con barriere all’ingresso effettivamente insormontabili.

E teme anche che gli effetti potrebbero essere ben peggiori se uno Stato entrasse in possesso della tecnologia.

“Mi preoccupa il modo in cui l’IA può consentire a uno Stato nazionale di creare, essenzialmente, uno Stato di sorveglianza, come sta facendo la Cina“, ha detto Obernolte. “Hanno creato essenzialmente il più grande stato di sorveglianza del mondo. Usano queste informazioni per fare dei punteggi predittivi sulla fedeltà delle persone al governo. E le usano come punteggi di fedeltà per assegnare privilegi. È piuttosto orwelliano”.

“Quindi questo è un modo dirompente in cui il governo può usarle“, ha aggiunto. “E, come abbiamo imparato per nostra sfortuna nella storia del nostro Paese, dobbiamo mettere delle barriere di sicurezza intorno al governo e all’industria“.

![joseph_lord]() Joseph Lord è giornalista di notizie politiche, analisi delle legislazioni in corso, delle elezioni statali e nazionali e delle politiche federali. Particolarmente interessato alle dinamiche di potere tra democratici progressisti e moderati alla Camera e al Senato, le leggi elettorali e di voto federali e le prossime battaglie elettorali.

Joseph Lord è giornalista di notizie politiche, analisi delle legislazioni in corso, delle elezioni statali e nazionali e delle politiche federali. Particolarmente interessato alle dinamiche di potere tra democratici progressisti e moderati alla Camera e al Senato, le leggi elettorali e di voto federali e le prossime battaglie elettorali.

Scelto e tradotto (IMC) da CptHook

CANALE YOUTUBE: https://www.youtube.com/@ComeDonChisciotte2003

CANALE RUMBLE: https://rumble.com/user/comedonchisciotte

CANALE ODYSEE: https://odysee.com/@ComeDonChisciotte2003

CANALI UFFICIALI TELEGRAM:

Principale - https://t.me/comedonchisciotteorg

Notizie - https://t.me/comedonchisciotte_notizie

Salute - https://t.me/CDCPiuSalute

Video - https://t.me/comedonchisciotte_video

CANALE UFFICIALE WHATSAPP:

Principale - ComeDonChisciotte.org