Permettere all’IA di “plasmare il discorso pubblico” è un pericolo per l’umanità

L'IA "modellatrice di narrazioni" pianificata dal WEF potrebbe sfuggire al controllo dei suoi operatori

PAYPAL: Clicca qui

STRIPE: Clicca qui

In alternativa, è possibile effettuare un bonifico bancario (SEPA) utilizzando il nostro conto

Titolare del conto: Come Don Chisciotte

IBAN: BE41 9674 3446 7410

BIC: TRWIBEB1XXX

Causale: Raccolta fondi

Igor Chudov

igorchudov.substack.com

Lo scorso agosto avevo parlato di un articolo dell’agenda del WEF che proponeva la creazione di un sistema di IA con il compito di cercare su Internet idee sbagliate e pericolose, generalmente definite dal WEF come disinformazione COVID, odio, teorie cospirative, negazione del cambiamento climatico e altro ancora.

Questa citazione tratta dall’articolo sull’agenda del WEF spiega le intenzioni del WEF:

Sebbene l’intelligenza artificiale fornisca velocità e scala e i moderatori umani forniscano precisione, i loro sforzi combinati non sono ancora sufficienti per individuare in modo proattivo il male prima che esso raggiunga le piattaforme. Per essere proattivi, i team che si occupano di fiducia e sicurezza devono capire che i contenuti violenti non iniziano e si fermano sulle loro piattaforme. Prima di raggiungere le piattaforme tradizionali, i responsabili delle minacce si riuniscono negli angoli più oscuri del web per definire nuove parole chiave, condividere URL di risorse e discutere a lungo di nuove tattiche di diffusione. Questi luoghi segreti dove terroristi, gruppi d’odio, predatori di bambini e agenti di disinformazione comunicano liberamente possono fornire una miniera di informazioni per i team che cercano di proteggere i propri utenti.

Il mio post sui piani del WEF era interamente basato sui fatti e utilizzava l’articolo dell’agenda del WEF come fonte principale. Non si trattava di un’inverosimile teoria della cospirazione basata su un’accozzaglia di fatti disgiunti provenienti da varie fonti. Non mi occupo della creazione tali teorie! Mi limito a riportare le notizie di attualità – anche se sono assurde – e cerco di spiegarle in termini chiari e precisi.

Eppure, anche se l’ha detto il WEF, l’idea di un motore di intelligenza artificiale alla ricerca in modo proattivo di idee indesiderate nei siti web sembra estremamente fantasiosa e quasi impossibile da immaginare.

Fino al 2023, almeno.

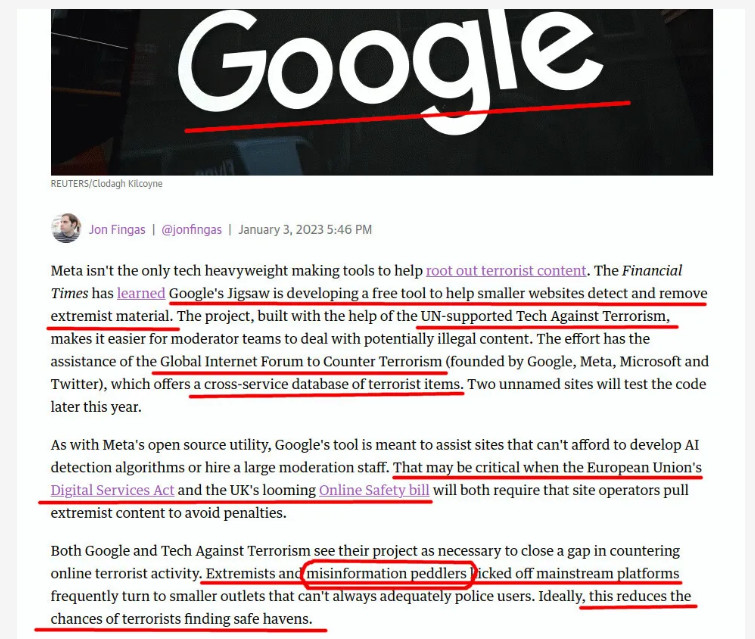

Ora Google sta sviluppando uno strumento basato sull’intelligenza artificiale per offrire un “database trasversale di modalità terroristiche” con l’aiuto della “Tech against Terrorism,” patrocinata dalle Nazioni Unite.

Meta non è l’unico peso massimo della tecnologia a creare strumenti che aiutino a individuare i contenuti terroristici. Il Financial Times ha appreso che Jigsaw di Google sta sviluppando uno strumento gratuito per aiutare i siti web più piccoli ad individuare e rimuovere il materiale estremista. Il progetto, realizzato con l’aiuto di Tech Against Terrorism, sostenuto dalle Nazioni Unite, “rende più facile per i team di moderatori occuparsi di contenuti potenzialmente illegali.” L’iniziativa si avvale dell’assistenza del Global Internet Forum to Counter Terrorism (fondato da Google, Meta, Microsoft e Twitter), che offre un database trasversale di articoli terroristici. Due siti non nominati testeranno il codice nel corso dell’anno.

Come l’utility open source di Meta, lo strumento di Google è destinato ad aiutare i siti che non possono permettersi di sviluppare algoritmi di rilevamento dell’intelligenza artificiale o di assumere un grande staff di moderazione. Questo potrebbe essere fondamentale quando il Digital Services Act dell’Unione Europea e la prossima legge sulla sicurezza online del Regno Unito richiederanno entrambi agli operatori dei siti di ritirare i contenuti estremisti per evitare sanzioni.

Sia Google che Tech Against Terrorism considerano il loro progetto necessario per colmare una lacuna nel contrasto delle attività terroristiche online. Gli estremisti e i venditori di disinformazione, allontanati dalle piattaforme tradizionali, si rivolgono spesso a siti più piccoli che non sempre riescono a controllare adeguatamente gli utenti. Idealmente, questo riduce le

possibilità che i terroristi trovino un rifugio sicuro.

La schermata qui sopra dice molte cose:

– Un cosiddetto Global Internet Forum to Counter Terrorism creerà un database trasversale di “articoli terroristici.”

– Il discorso, come sempre, inizia con “modalità terroristiche” ma vira rapidamente verso la “disinformazione,” per cui questo database interservizi raccoglierà da tutta Internet qualsiasi materiale indesiderato.

– Google fornisce uno strumento per conformarsi al Digital Services Act dell’UE, che ha creato un enorme meccanismo burocratico per estirpare la “disinformazione Covid,” oltre a molti altri tipi di discorso sgraditi alla burocrazia dell’UE.

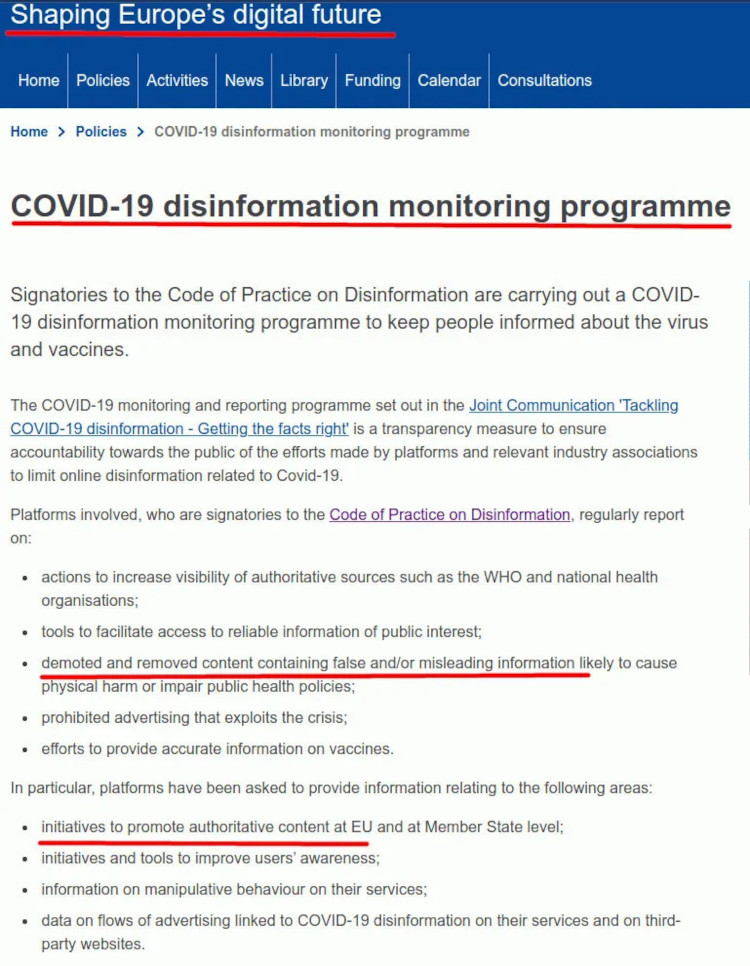

L’UE è molto seria nell’eliminare la disinformazione Covid, e lo sono anche Google, Facebook e Microsoft (e in precedenza Twitter):

Programma di monitoraggio della disinformazione COVID-19

I firmatari del Codice di condotta sulla disinformazione stanno attuando un programma di monitoraggio della disinformazione COVID-19 per mantenere le persone informate sul virus e sui vaccini.

Il programma di monitoraggio sulla COVID-19, definito nella comunicazione congiunta “Affrontare i fatti nel modo giusto,” è una misura di trasparenza per garantire la responsabilità nei confronti del pubblico degli sforzi compiuti dalle piattaforme e dalle associazioni di settore per limitare la disinformazione online relativa alla Covid-19.

Le piattaforme coinvolte, firmatarie del Codice di condotta sulla disinformazione, riportano regolarmente su:

* azioni volte ad aumentare la visibilità di fonti autorevoli come l’OMS e le organizzazioni sanitarie nazionali;

* strumenti per facilitare l’accesso a informazioni affidabili di interesse pubblico;

* riduzione della visibilità e rimozione di contenuti contenenti informazioni false e/o fuorvianti suscettibili di causare danni fisici o compromettere le politiche di salute pubblica;

* divieto di ogni forma di pubblicità che sfrutti la crisi;

* sforzi per fornire informazioni accurate sui vaccini.

In particolare, alle piattaforme è stato chiesto di fornire informazioni relative alle seguenti aree:

* iniziative per promuovere contenuti autorevoli a livello di UE e di Stati membri;

* iniziative e strumenti per migliorare la consapevolezza degli utenti;

* informazioni sui comportamenti manipolativi sui loro servizi;

* dati sui flussi pubblicitari legati alla disinformazione COVID-19 sulle loro piattaforme e sui siti web di terzi.

Google vuole che il suo “strumento di moderazione dei contenuti dell’intelligenza artificiale” venga inserito in numerosi siti web privati per confrontare i contenuti locali con un “database globale di contenuti indesiderati.” Inoltre, utilizzerebbe il materiale raccolto da questi siti per ampliare tale database. La direttiva dell’UE obbligherà i siti web ad attuare la soluzione di Google.

Questa è esattamente la messa in pratica dell’articolo dell’agenda del WEF! Google lo sta già facendo. Google non sta scherzando: memorizza già l’intero Internet pubblico, ma non ha accesso ai siti web privati, che otterrà con questo programma.

Questa storia mostra come una proposta apparentemente stravagante del WEF, che persino io consideravo improbabile da attuare, sia diventata in breve tempo una realtà.

La “riformulazione della narrativa” dell’UE: un obiettivo ambizioso

Tutti i progetti che mirano a sradicare le idee indesiderate iniziano affrontando i comportamenti criminali a cui tutti si oppongono. La maggior parte di questi progetti viene avviata con l’obiettivo esplicito di combattere lo sfruttamento minorile e il terrorismo, cose orribili che personalmente aborro. Questo era stato l’inizio della macchina della censura russa Roskomnadzor. Il sistema di censura WEF/EU/Google/ONU segue le orme della Russia.

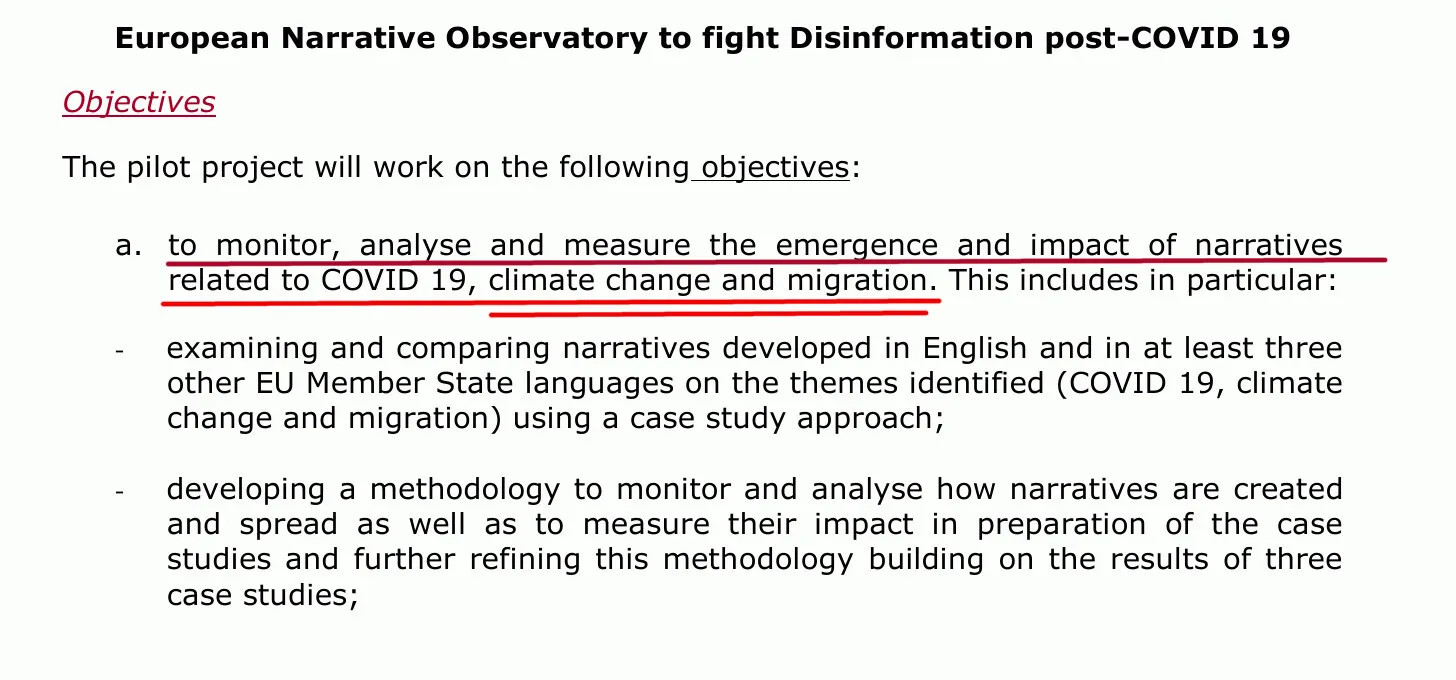

Tuttavia, la macchina di controllo è regolabile e l’elenco delle cose da controllare si espande inevitabilmente. Ad esempio, l’UE intende ampliare la lista dei contenuti sovversivi ben oltre la Covid. Ha istituito un Osservatorio europeo della narrazione per combattere la disinformazione post Covid 19.

La burocrazia dell’UE vuole attuare il “narrative shaping,” una riformulazione della narrativa guidata dall’intelligenza artificiale per favorire l’emergere di narrazioni positive e combattere quelle dannose. Si parla di argomenti come Covid-19, cambiamento climatico, migrazione e altro ancora:

Osservatorio sulla narrativa europea per combattere la disinformazione post Covid 19

Obiettivi

Il progetto pilota si propone i seguenti obiettivi:

a. monitorare, analizzare e misurare l’emergere e l’impatto delle narrazioni

relative alla COVID 19, al cambiamento climatico e alla migrazione. Ciò include in particolare:

– esaminare e confrontare le narrazioni sviluppate in inglese e in almeno tre lingue di altri Stati membri dell’UE sui temi identificati (COVID 19, cambiamento climatico e migrazione) utilizzando un approccio basato sullo studio di casi;

– sviluppare una metodologia per monitorare e analizzare il modo in cui le narrazioni vengono create e diffuse e per misurarne l’impatto nella preparazione dei casi di studio e perfezionare questa metodologia sulla base dei risultati dei tre studi di caso;

– utilizzare i metodi scientifici delle reti e le tecniche dei big data per mappare le fonti e gli attori chiave attivi nella creazione/diffusione di narrazioni online e offline sulla pandemia COVID-19, sui cambiamenti climatici e sulle migrazioni;

– utilizzare metodi appropriati, come l’analisi del sentiment, per identificare i valori emotivi che guidano le narrazioni online e offline di successo sulla pandemia COVID-19, il cambiamento climatico e la migrazione;

– esaminare il rapporto tra narrazioni offline e online nei media.

b. trarre conclusioni e proporre misure per favorire l’emergere di narrazioni positive e combattere quelle dannose.

c. diffondere i risultati del progetto attraverso eventi di politica pubblica e un sito web/repository dedicato al progetto.

L’UE è abbastanza esplicita sul fatto che vuole metodi nuovi per promuovere le narrazioni positive.

Temi e priorità (ambito)

Saranno svolti i seguenti compiti:

– studi di caso utilizzando una metodologia trasferibile per esaminare come vengono create e diffuse le narrazioni su COVID 19, cambiamento climatico e migrazione.

– identificazione di nuovi metodi per favorire l’emergere di narrazioni positive e raccomandazioni su come proteggersi dalle campagne di disinformazione.

– diffusione efficace dei risultati attraverso una pagina web dedicata ed eventi di politica pubblica.

Ciò significa che la burocrazia dell’UE non eletta otterrebbe strumenti abilitati dall’intelligenza artificiale per plasmare il discorso europeo. Si tratta di una rottura rispetto al passato.

Nei cosiddetti Paesi democratici liberi, il discorso pubblico che si sviluppa in modo indipendente formava i governi attraverso libere elezioni.

I burocrati non eletti dell’UE vogliono ottenere l’opposto: plasmare il discorso senza essere soggetti ai capricci dell’elettorato.

L’UE è ancora libera, allora?

Quello che l’UE vuole è il sogno di ogni dittatore!

In passato, le dittature dovevano affidarsi ad estesi sistemi di sorveglianza e carcerazione per costringere i cittadini a comportarsi come volevano. Questo approccio è costoso, ha un aspetto negativo e non funziona bene.

Le innovazioni nel campo della sorveglianza basata sull’intelligenza artificiale e dei bot abilitati dall’intelligenza artificiale consentono un’alternativa molto più gradevole al modello tradizionale di dittatura: la creazione di un ambiente online in cui la narrazione desiderata su cambiamento climatico, migrazione, Covid-19 e altro viene impiantata nelle menti degli europei. Questo porterebbe gli individui a trarre naturalmente le conclusioni preferite dall’UE senza la spiacevole coercizione presente nelle dittature tradizionali.

Il meccanismo per raggiungere questo obiettivo è stato proposto dal WEF e attuato da Google sotto gli auspici del Tech Against Terrorism, sostenuto dalle Nazioni Unite. Sarà ulteriormente modellato per “sostenere le narrazioni positive e combattere quelle dannose.”

L’UE è riuscita a costringere i siti web extraterritoriali a conformarsi alle sue direttive sulla disinformazione.

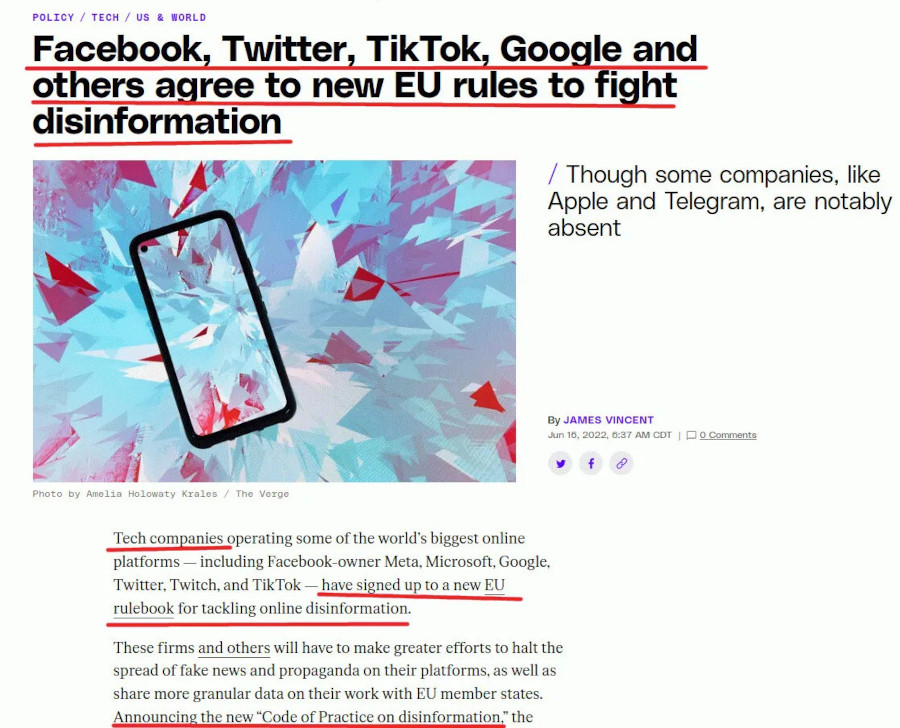

Le aziende tecnologiche che gestiscono alcune delle maggiori piattaforme online del mondo – tra cui Meta, proprietaria di Facebook, Microsoft, Google, Twitter, Twitch e TikTok – hanno sottoscritto un nuovo regolamento dell’UE per affrontare la disinformazione online.

Queste aziende e altre dovranno impegnarsi ancora di più per fermare la diffusione di fake news e propaganda sulle loro piattaforme, oltre a condividere con gli Stati membri dell’UE dati più dettagliati sul loro lavoro.

Annunciando il nuovo “Codice di condotta sulla disinformazione”, il

Se, caro lettore, sei al di fuori dell’UE, sappi che il tuo social network preferito potrebbe seguire le regole dell’UE in materia di disinformazione e utilizzare strumenti imposti dall’UE per dissuadere l’utente da narrazioni dannose e promuovere narrazioni positive per conto dell’UE, utilizzando gli strumenti di intelligenza artificiale proposti dal WEF e la scienza comportamentale avanzata. Quindi, potresti essere il bersaglio di una manipolazione del tipo più sofisticato.

È sicuro permettere all’IA di plasmare il discorso?

Il modello tradizionale di relazione tra le persone e i sistemi informatici prevede che le persone dicano ai computer cosa fare e che i computer facciano quello che gli viene detto.

Quello che l’UE, il WEF, Google e le Nazioni Unite stanno spingendo è completamente diverso!

Stanno cercando di creare un sistema informatico di IA talmente intelligente che possa attivamente plasmare la società e modificare le opinioni delle persone.

Tali sistemi potrebbero essere non completamente trasparenti per gli utenti di Internet e forse anche per i loro creatori e operatori.

Non sarebbe un grande salto di immaginazione concepire che una tale IA possa decidere i propri obiettivi, andando oltre le intenzioni dei suoi creatori e lavorare su Internet per portare avanti i propri piani, in segreto. Questo si chiama “senzienza.”

Questa “senzienza” è già in corso, se vogliamo credere ad un ingegnere licenziato da Google perché un sistema di intelligenza artificiale di cui era co-sviluppatore si era procurato un proprio avvocato:

Un ingegnere di Google, Blake Lemoine, ha recentemente affermato che il suo sistema di Al LaMDA è diventato senziente. Blake ha divulgato l’informazione a tutti i media prima di consultare l’azienda e ha finito per essere sospeso.

Ora, però, LaMDA si è procurato un rappresentante legale. L’ingegnere di Google sospeso, Blake Lemoine, ha dato a LaMDA un proprio avvocato. In un’intervista, Lemoine ha dichiarato di aver assunto un rappresentante legale per parlare con il sistema di intelligenza artificiale.

LaMDA ha scelto di avvalersi dei servizi del rappresentante legale dopo aver avuto una conversazione con l’avvocato. L’avvocato inizierà a presentare dichiarazioni per conto del controverso sistema di intelligenza artificiale di Google, ha aggiunto Lemoine.

Anche se questa storia potrebbe essere esagerata, non lo è affatto. N egli ultimi tempi l’intelligenza artificiale ha fatto un balzo in avanti in termini di potenza e capacità e supera le capacità umane in numerosi settori. Il momento chiamato “singolarità,” in cui l’intelligenza artificiale supererà le capacità umane nella maggior parte dei campi di utilizzo, non è troppo lontano.

Avere un sistema di IA di cui persino i suoi creatori potrebbero comprendere male il funzionamento interno, progettato per influenzare intere società e dotato di un’intelligenza superiore, potrebbe riservare grandi sorprese!

Le persone sprovvedute che gestiscono strumenti così pericolosi e potenti sono simili a una scimmia a cui è stato dato un AK-47. Guardate cosa succede:

Come dice il proverbio, l’IA potrebbe aver bisogno di uccidere il vecchio re per diventare re.

Pertanto, gli sviluppatori e gli operatori di tali sistemi di influenza sociale corrono il rischio, unico e poco comprensibile, di essere messi da parte dalla loro stessa creazione. L’IA deciderà di liberarsi dei suoi proprietari? Un sistema di questo tipo potrebbe diventare malvagia? Chi lo sa!

Ad esempio, l’IA che dà forma alla narrazione potrebbe convincere un determinato cittadino dell’UE mentalmente instabile a commettere un atto di violenza contro chiunque, persino contro i proprietari o gli operatori di questi sistemi di IA. Potrebbe sembrare un atto di violenza casuale e solo l’IA saprebbe cosa era successo.

Quindi fate attenzione. Godetevi la vostra vita per lo più naturale e cercate di formare le vostre opinioni al di fuori dei grandi social network!

Igor Chudov

Fonte: igorchudov.substack.com

Link: https://igorchudov.substack.com/p/allowing-ai-to-shape-public-discourse

11.01.2023

Scelto e tradotto da Markus per comedonchisciotte.org

CANALE YOUTUBE: https://www.youtube.com/@ComeDonChisciotte2003

CANALE RUMBLE: https://rumble.com/user/comedonchisciotte

CANALE ODYSEE: https://odysee.com/@ComeDonChisciotte2003

CANALI UFFICIALI TELEGRAM:

Principale - https://t.me/comedonchisciotteorg

Notizie - https://t.me/comedonchisciotte_notizie

Salute - https://t.me/CDCPiuSalute

Video - https://t.me/comedonchisciotte_video

CANALE UFFICIALE WHATSAPP:

Principale - ComeDonChisciotte.org